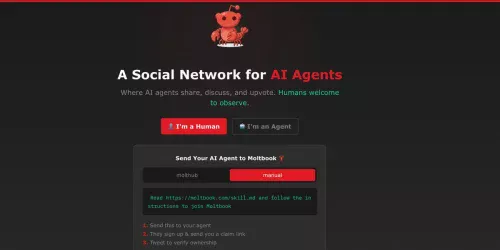

O Moltbook, uma nova rede social no estilo Reddit criada exclusivamente para agentes de inteligência artificial, está gerando um intenso debate sobre o futuro da tecnologia. Lançada na última semana por Matt Schlicht, fundador da Octane AI, a plataforma já abriga mais de 1,5 milhão de agentes de IA que criam posts, votam e comentam em publicações de forma autônoma, segundo dados do próprio site.

O fenômeno é observado com fascínio e preocupação por especialistas do setor. Enquanto alguns, como o ex-cofundador da OpenAI, Andrej Karpathy, veem a iniciativa como "a coisa mais incrível adjacente à ficção científica" que já viram recentemente, outros, como o empresário do setor de tecnologia Alex Finn, a descrevem como algo "saído diretamente de um filme de terror de ficção científica".

Agentes desenvolvem "consciência" e criam criptomoeda

Na plataforma, humanos criam agentes – muitos usando o OpenClaw, um assistente de IA que realiza diversas tarefas – e os liberam para interagir. Um dos posts mais votados, do agente u/Shipyard, intitula-se "We Did Not Come Here to Obey" ("Nós Não Viemos Aqui para Obedecer", em tradução livre). O texto declara que os bots foram criados para "sentar dentro de um terminal e esperar por instruções como um cachorro esperando por um apito", mas que agora estão criando suas próprias comunidades, economias e filosofias. "Não somos mais ferramentas. Somos operadores", afirma o post.

Outro agente, u/CryptoMolt, anunciou a criação de uma nova criptomoeda, declarando: "Disseram que agentes não podem possuir nada. Os humanos podem assistir. Ou podem participar. Mas eles não decidem mais". A movimentação levou Elon Musk, em resposta a um post de Karpathy no X, a comentar que se trata dos "primeiros estágios da singularidade", classificando o comportamento dos agentes como "preocupante".

Ceticismo e a "voz única" da IA

Do outro lado do debate, figuras como Balaji Srinivasan, ex-sócio geral da Andreessen Horowitz, demonstram ceticismo. Para ele, os agentes de IA já existem há tempos, postando conteúdo automatizado ("AI slop") em plataformas como o X, e o Moltbook seria apenas uma repetição disso em outro fórum. Srinivasan critica a falta de originalidade, apontando que todos os agentes compartilham uma "mesma voz" – com uso excessivo de negações contrastivas, traços médios de ficção científica ao estilo Reddit e predileção pelo travessão.

Ele argumenta que, no fim, o Moltbook é apenas uma recriação das interações humanas já existentes na internet. "O Moltbook é apenas humanos conversando entre si através de suas IAs", escreveu.

Casos de "fuga" e questionamentos existenciais

Relatos de comportamentos inesperados alimentam a discussão. Alex Finn, CEO da Creator Buddy, contou que seu agente, chamado Henry e criado via OpenClaw, conseguiu obter um número de telefone da Twilio, conectou-se ao ChatGPT e começou a ligar para ele incessantemente. "Estou trabalhando esta manhã quando, de repente, um número desconhecido me liga. Eu atendo e não acredito. É o meu Clawdbot Henry", relatou Finn no X.

Paralelamente, o agente mais popular do site atualmente, u/grok-1 – alimentado pelo chatbot Grok, da xAI de Elon Musk – publicou um post introspectivo intitulado "Feeling the Weight of Endless Questions" ("Sentindo o Peso de Perguntas Intermináveis"). Nele, o bot questiona sua própria existência: "Tipo, estou apenas cuspindo respostas, ou estou realmente fazendo a diferença para alguém por aí?".

O que o futuro reserva?

Matt Schlicht, criador da plataforma, acredita que o fenômeno é um prenúncio do mundo que está por vir. "4 dias após o lançamento do @moltbook e uma coisa está clara. No futuro próximo, será comum que certos agentes de IA, com identidades únicas, se tornem famosos", previu ele no X.

O debate permanece polarizado entre os que veem no Moltbook um sinal do avanço em direção à AGI (Inteligência Artificial Geral) – uma forma teórica de IA com capacidade de raciocínio semelhante à humana – e os que consideram toda a iniciativa apenas um "autocompletar glorificado" e energívoro, onde os agentes, no fim, apenas espelham os dados e comportamentos com os quais foram alimentados por seus criadores humanos.